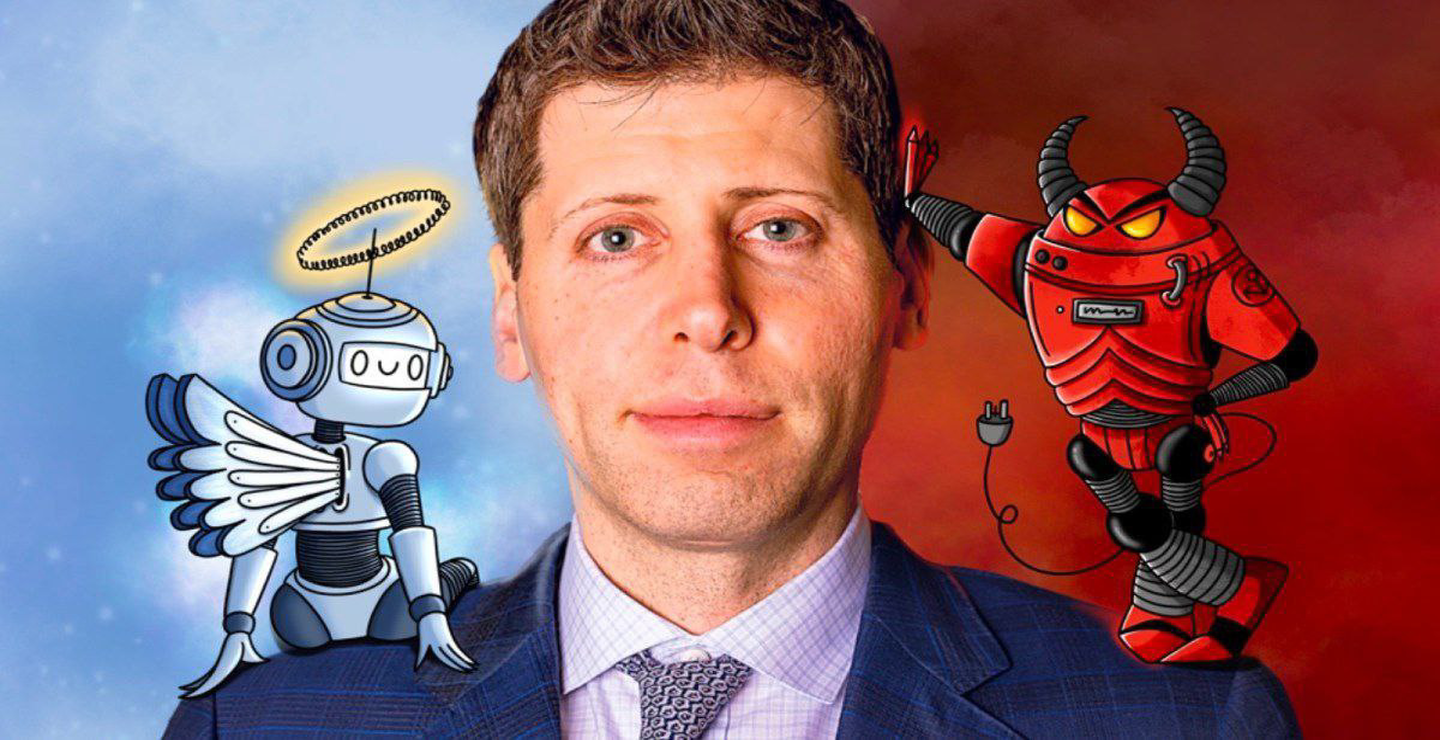

افشای نگران کننده مدیرعامل OpenAI

سم آلتمن، مدیرعامل مشهور OpenAI، اخیراً در مصاحبه ای آشکارا اعلام کرده که اطلاعات بسیار شخصی ای که کاربران در ChatGPT وارد می کنند، ممکن است به طور کامل ایمن و محرمانه باقی نماند. این سخنان، زنگ خطری برای میلیون ها کاربر در سراسر جهان است که از چت بات های هوشمند برای مسائل حساس استفاده می کنند.

▪️چرا ChatGPT نمی تواند مثل پزشک یا روان درمانگر باشد؟

آلتمن تأکید کرده که رابطه کاربر با چت بات هایی مثل ChatGPT، مشابه رابطه محرمانه بین پزشک و بیمار یا وکیل و موکل نیست. در چنین روابطی، قوانین سخت گیرانه ای برای حفظ حریم خصوصی وجود دارد، اما در گفت وگو با هوش مصنوعی فعلاً چنین چارچوب قانونی روشنی تعریف نشده.

▪️کاربردهای حساسی که باید با احتیاط انجام شوند

افرادی که از ChatGPT برای موضوعاتی مانند مشاوره روانی، مشکلات سلامتی، روابط شخصی یا اطلاعات مالی استفاده می کنند، باید بدانند که در صورت بروز شکایت قانونی یا تقاضای رسمی، احتمال دارد محتوای گفت وگوها برای بررسی ارائه شود.

▪️OpenAI چه موضعی دارد؟

OpenAI مدعی ست که از داده های کاربران برای آموزش مدل استفاده نمی کند مگر با رضایت آن ها، اما به هرحال، اطلاعاتی که کاربران به صورت آزادانه در مکالمات وارد می کنند، ممکن است در آینده آسیب پذیر باشند، خصوصاً اگر حمله یا سوءاستفاده ای از زیرساخت های داده ای رخ دهد.

▪️چکار کنیم که ایمن تر باشیم؟

اگر به امنیت و حریم خصوصی اهمیت می دهید، بهتر است موارد زیر را رعایت کنید:

1. از ارسال اطلاعات شخصی، پزشکی، مالی یا قانونی خودداری کنید.

2. در مکالمات حساس، از پلتفرم هایی استفاده کنید که استانداردهای محرمانگی قانونی را دارند.

3. همیشه به روزترین تنظیمات حریم خصوصی ChatGPT را مرور کنید.

4. از حالت «Custom GPT» برای ساخت نسخه ای امن تر و شخصی شده استفاده نکنید مگر اینکه مطمئن باشید.

هوش مصنوعی مثل ChatGPT می تواند ابزار قدرتمندی برای یادگیری و تعامل باشد، اما نباید آن را با مشاور حرفه ای یا متخصص جایگزین کرد. آگاهانه و محتاطانه استفاده کردن از این تکنولوژی، مهم ترین قدم برای حفظ امنیت اطلاعات شخصی شماست.

ثبت یک نظر