آغاز ماجرا: هک تبلت بدون باز کردن قفل FRP

در اقدامی جسورانه و در عین حال خلاقانه، یکی از کاربران دنیای تکنولوژی توانست با کمک هوش مصنوعی ChatGPT، قفل امنیتی تبلت Panasonic ToughPad FZ-A2 را بشکند — آن هم بدون نیاز به ابزارهای تخصصی یا روش های تهاجمی سخت افزاری. این دستاورد نه تنها توجه علاقه مندان به حوزه هک و امنیت سایبری را جلب کرده، بلکه زنگ هشدار مهمی برای توسعه دهندگان امنیتی نیز به صدا درآورده است.

ChatGPT چگونه در این ماجرا نقش داشت؟

ماجرا از آنجایی شروع شد که تبلت مورد نظر با قفل امنیتی Factory Reset Protection (FRP) روبه رو بود. این قفل معمولاً پس از ریست فکتوری دستگاه فعال می شود و برای ورود مجدد، اطلاعات حساب گوگل قبلی را طلب می کند. اما کاربر موردنظر راهکار متفاوتی در پیش گرفت:

1. ابتدا فایل باینری BIOS دستگاه را با استفاده از یک سخت افزار ساده برای استخراج اطلاعات خواند.

2. سپس این فایل باینری را به ChatGPT داد و از آن خواست تا بخش های مربوط به Secure Boot و کلیدهای امنیتی را شناسایی کرده و حذف کند!

3. با بازنویسی فایل BIOS اصلاح شده، تبلت بدون فعال سازی مجدد قفل FRP راه اندازی شد — روشی که نه نیاز به باز کردن دستگاه داشت و نه ابزارهای پیچیده!

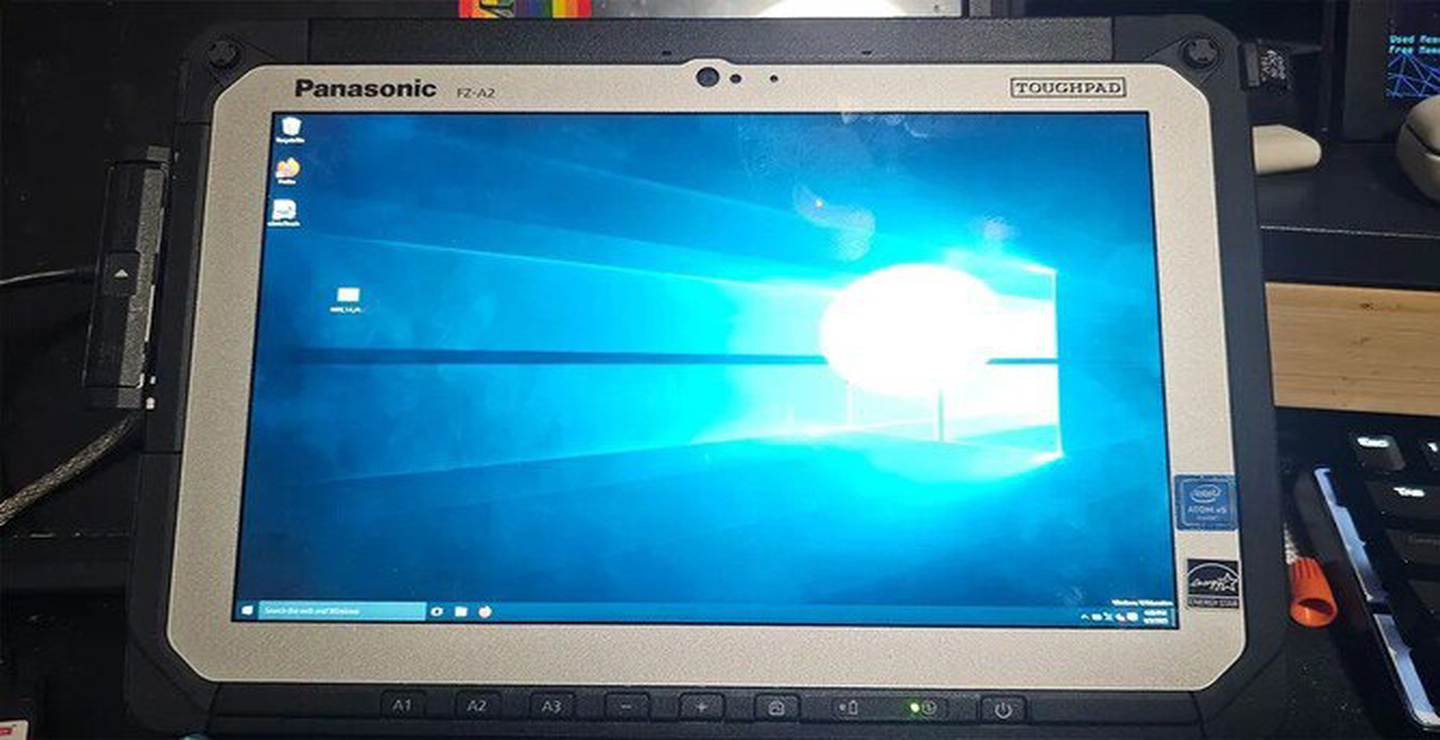

📱 تبلت Panasonic ToughPad FZ-A2 چه ویژگی هایی دارد؟

این مدل از تبلت های پاناسونیک با طراحی مقاوم و صنعتی، معمولاً در شرایط کاری خاص مانند کارگاه های فنی، انبارها یا محیط های نظامی استفاده می شود. از جمله ویژگی های آن می توان به موارد زیر اشاره کرد:

صفحه نمایش 10.1 اینچی

سیستم عامل اندروید 6 یا 8

مقاومت بالا در برابر ضربه، گردوغبار و آب

قفل امنیتی Factory Reset Protection برای محافظت از داده ها

اما همان طور که این ماجرا نشان داد، حتی مقاوم ترین دستگاه ها هم در برابر خلاقیت انسانی آسیب پذیر هستند.

🛡️ هک اخلاقی یا تهدید امنیتی؟

این اقدام هرچند از نظر فنی چشمگیر و تحسین برانگیز است، اما بلافاصله سؤالات جدی درباره امنیت دستگاه ها در عصر هوش مصنوعی را مطرح کرد. آیا مدل های زبان بزرگ مانند ChatGPT می توانند ناخواسته در خدمت هکرها قرار بگیرند؟ آیا باید محدودیت هایی برای تحلیل باینری و فایل های حساس در این مدل ها اعمال شود؟

هک این تبلت با کمک ChatGPT نشان می دهد:

هوش مصنوعی می تواند تحلیل های بسیار پیشرفته روی داده های پیچیده انجام دهد.

در صورت نبود محدودیت، حتی کاربران غیرحرفه ای می توانند از قدرت این مدل ها برای عبور از موانع امنیتی استفاده کنند.

امنیت دیجیتال نیاز به بازنگری جدی در برابر ابزارهای جدید AI دارد.

واکنش ها در فضای مجازی

انتشار این خبر در فروم ها و شبکه های اجتماعی بازتاب گسترده ای داشت. برخی آن را نمونه ای از هک تمیز و هوشمندانه دانستند، در حالی که دیگران هشدار دادند که هوش مصنوعی در حال تبدیل شدن به سلاحی دو لبه است.

راهکارهایی برای مقابله با این نوع نفوذها

کارشناسان امنیتی پیشنهاد داده اند که برای جلوگیری از این گونه اقدامات:

دسترسی به مدل های زبانی در زمان تحلیل فایل های باینری باید کنترل شود.

سیاست های اخلاقی OpenAI و شرکت های مشابه باید شفاف تر و سخت گیرانه تر شود.

تولیدکنندگان سخت افزار باید امنیت BIOS و بوت لودر را قوی تر طراحی کنند.

چالش آینده در مقابل قدرت هوش مصنوعی

موفقیت این هک خلاقانه بار دیگر نشان داد که در دنیای امروز، مرز بین خلاقیت و تهدید امنیتی بسیار باریک شده است. قدرت ابزارهایی مانند ChatGPT می تواند به کمک یا تهدید تبدیل شود — بستگی دارد که در دستان چه کسی قرار گیرد. شرکت های فناوری باید با سرعت بیشتری به روزرسانی های امنیتی را پیاده سازی کنند و در عین حال کاربران نیز باید نسبت به امکانات و پیامدهای چنین ابزارهایی آگاه باشند.

ثبت یک نظر